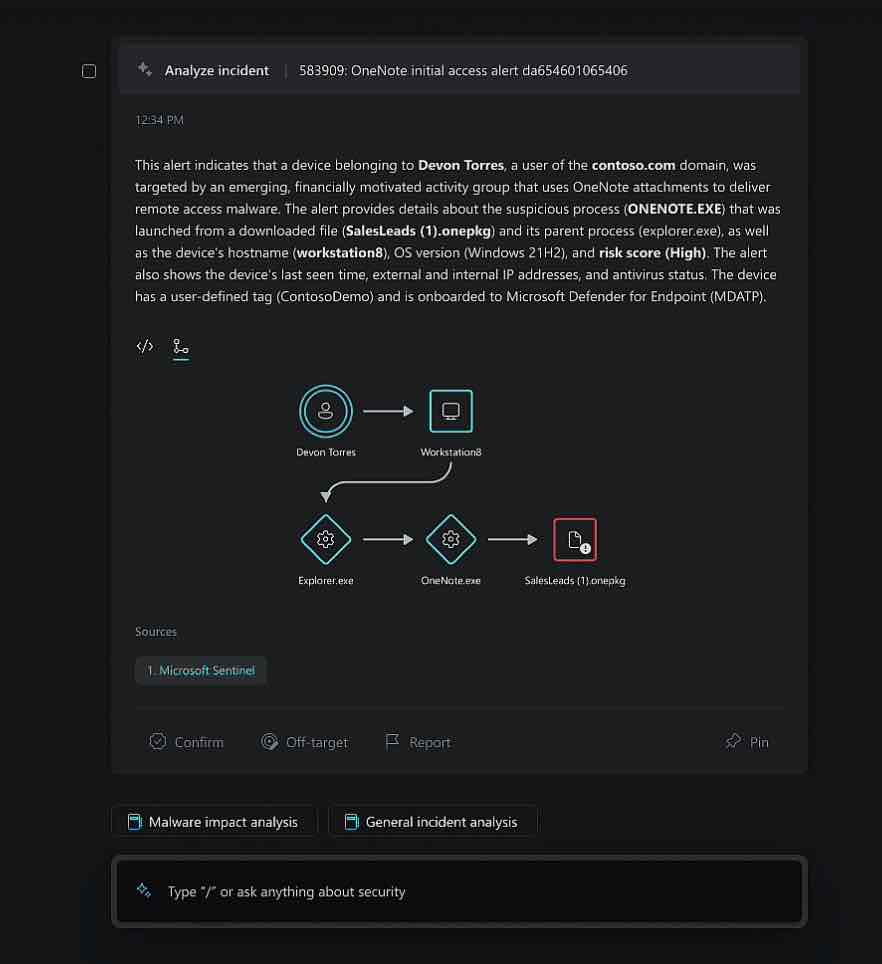

Rapportage van Security Copilot van Microsoft (afb: Microsoft)

Kunstmatige intelligentie is de plek waar je moet zijn, ook met je digitale veiligheid. Ki wordt al gebruikt om verdachte activiteiten op het web op te sporen. De meeste zelflerende systemen hebben echter alleen ‘verstand’ van een deel van de bedreigingen zoals het ontdekken van kwalijke codes. Nu schijnt Microsoft samen met OpenAI en zijn kletsbot ChatGPT-4 Security Copilot in de strijd geworpen te hebben die het wat breder zou aanpakken.

Dat was twee weken na de introductie van Microsof 365 Copilot. Security Copilot zou naast van ChatGPT ook gebruik maken van een zelf ontwikkeld beveiligingsmodel vanMicrosoft. Het systeem belooft alles op te sporen. Daarbij valt het systeem te corrigeren (niet belangrijk oid). Het blijft dus leren, begrijp ik (=as). Zo kan het systeem analyseren wat een bepaalde code doet en tegenmaatregelen voorstellen, uiteraard 24 uur per dag.

Microsoft meldt trots dat het 65 biljoen signalen per dag gebruikt uit zijn gigantische databestand voor het detecteren van kwaadaardige en verdachte operaties en de vorming van een effectieve afweer. Security Copilot zou aan dezelfde privacyregels voldoen als alle andere beveiligingsproducten waar de copiloot mee samenwerkt. Als je al Sentinel of Defender van Microsoft gebruikt dan plooit Security Copilot zich naar de regels van die systemen, aldus Microsoft.

Bron: Wired